Zagadnienia

14. Liniowe szeregi czasowe

Stacjonarność rzędu 2. Funkcje tworzące. Klasyczne modele liniowe MA, AR, ARMA i ARIMA. Ułamkowe ruchy Browna. (1 wykład)

14.1. Szeregi czasowe stacjonarne rzędu 2

Na początek ustalmy przestrzeń probabilistyczną

Przez ![]() będziemy oznaczać zbiór zmiennych losowych

będziemy oznaczać zbiór zmiennych losowych ![]() takich, że

takich, że ![]() . Jak łatwo zauważyć jest to przestrzeń liniowa nad

. Jak łatwo zauważyć jest to przestrzeń liniowa nad ![]() . Ponadto, gdy utożsamimy zmienne losowe, które są prawie wszędzie równe to funkcja

. Ponadto, gdy utożsamimy zmienne losowe, które są prawie wszędzie równe to funkcja

jest normą, a ![]() jest przestrzenią Banacha (por. [9] dodatek C.5

lub [3] §2.10).

jest przestrzenią Banacha (por. [9] dodatek C.5

lub [3] §2.10).

Dla ustalenia uwagi przyjmiemy następującą definicję szeregu czasowego.

Definicja 14.1

Szeregiem czasowym nazywamy ciąg zmiennych losowych ![]() o wartościach rzeczywistych,

o wartościach rzeczywistych, ![]()

Definicja 14.2

Szereg czasowy ![]() nazywamy stacjonarnym rzędu 2 gdy

nazywamy stacjonarnym rzędu 2 gdy

| a. | ||||

| b. | ||||

| c. |

Zauważmy, że czasami stacjonarność rzędu 2 implikuje silną stacjonarność.

Lemat 14.1

Gaussowski szereg czasowy stacjonarny rzędu 2 jest silnie stacjonarny w sensie definicji 8.6.

Dowód.

Jeśli ![]() jest procesem Gaussowskim to dla kazdego

jest procesem Gaussowskim to dla kazdego ![]() łączny rozkład

łączny rozkład ![]() jest rozkładem normalnym

jest rozkładem normalnym ![]() , gdzie

, gdzie

Podobnie dla dowolnego ![]() łączny rozkład

łączny rozkład ![]() jest rozkładem normalnym

jest rozkładem normalnym ![]() , gdzie

, gdzie

Ponieważ

to oba rozkłady są identyczne.

Podstawowymi narzędziami służącymi do opisu stacjonarnych szeregów czasowych są funkcje autokowariancji.

Dla każdego stacjonarnego rzędu 2 szeregu czasowego ![]() definiujemy funkcję

definiujemy funkcję ![]()

przyporządkowującą liczbie całkowitej ![]() -

- ![]() -ty współczynnik autokowariancji

(patrz definicja 11.1)

-ty współczynnik autokowariancji

(patrz definicja 11.1)

Zauważmy, że ze stacjonarności wynika, że dla każdego ![]()

a w szczególności

Twierdzenie 14.1

Niech ![]() , wówczas funkcja autokowariancji stacjonarnego szeregu czasowego spełnia następujące warunki

, wówczas funkcja autokowariancji stacjonarnego szeregu czasowego spełnia następujące warunki

| 1. | ||||

| 2. | ||||

| 3. | ||||

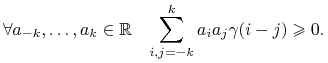

| 4. |  |

Uwaga 14.1

Funkcje spełniające warunek 4 dla każdego ![]() nazywa się dodatnio określonymi.

nazywa się dodatnio określonymi.

Dowód.

Punkt 1 wynika z symetrii kowariancji.

Punkt 2 jest oczywisty.

Punkt 3 wynika ze związków między korelacją i kowariancją.

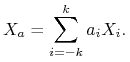

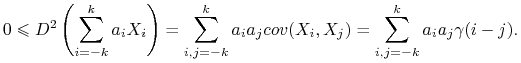

Punkt 4 wynika z nieujemności wariancji zmiennej losowej. Rozważmy zmienną losową

|

Korzystając z dwuliniowości kowariancji otrzymujemy

|

Prawdziwe jest również twierdzenie odwrotne.

Twierdzenie 14.2

Jeśli funkcja ![]() spełnia warunki 1,2,3 i 4 z powyższego twierdzenia to jest ona funkcją autokowariancji pewnego stacjonarnego szeregu czasowego.

spełnia warunki 1,2,3 i 4 z powyższego twierdzenia to jest ona funkcją autokowariancji pewnego stacjonarnego szeregu czasowego.

Dowód

Patrz – [3] Theorem 1.5.1.

Zachowanie się funkcji autokowariancji dla dużych ![]() ma istotne znaczenie w praktycznych zastosowaniach.

Wyróżnia się dwie klasy szeregów czasowych stacjonarnych rzędu 2.

ma istotne znaczenie w praktycznych zastosowaniach.

Wyróżnia się dwie klasy szeregów czasowych stacjonarnych rzędu 2.

Definicja 14.3

Niech ![]() będzie szeregiem czasowym stacjonarnym rzędu 2, a

będzie szeregiem czasowym stacjonarnym rzędu 2, a ![]() jego funkcją autokowariancji.

jego funkcją autokowariancji.

Gdy ![]() zbiega do zera dla dużych

zbiega do zera dla dużych ![]() w sposób wykładniczy

w sposób wykładniczy

to mówimy, że ![]() jest procesem o krótkiej pamięci.

jest procesem o krótkiej pamięci.

W przeciwnym przypadku mówimy, że ![]() jest procesem o długiej pamięci.

jest procesem o długiej pamięci.

Gdy szereg czasowy nie jest prawie na pewno stały czyli gdy ![]() to definiujemy dodatkowo funkcję

autokorelacji

to definiujemy dodatkowo funkcję

autokorelacji

Kluczowym obiektem w teorii szeregów czasowych stacjonarnych rzędu 2 jest biały szum. Jest to przykład procesu o (bardzo!) krótkiej pamięci.

Definicja 14.4

Stacjonarny rzędu 2 szereg czasowy ![]() nazywamy białym szumem gdy

nazywamy białym szumem gdy

Gdy dodatkowo ![]() to

to ![]() nazywamy unormowanym białym szumem.

nazywamy unormowanym białym szumem.

Zbiór szeregów czasowych będących białym szumem o wariancji ![]() będziemy oznaczać

będziemy oznaczać ![]() .

.

Uwaga 14.2

Kolejne wyrazy białego szumu są nieskorelowane ale nie muszą być niezależne, chyba, że jest to gaussowski biały szum.

14.2. Sploty vel filtry

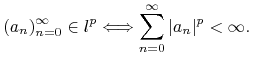

Na początek przypomnimy, kiedy ciąg liczb rzeczywistych jest klasy ![]() .

.

Definicja 14.5

Ciąg ![]() należy do klasy

należy do klasy ![]() gdy jest sumowalny w

gdy jest sumowalny w ![]() -tej potędze.

-tej potędze.

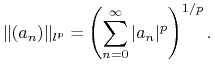

|

Uwaga 14.3

Zauważmy, że ![]() zawiera

zawiera ![]() . Ponadto dla

. Ponadto dla ![]() klasy

klasy ![]() są unormowanymi przestrzeniami liniowymi

są unormowanymi przestrzeniami liniowymi

|

Definicja 14.6

Niech ![]() będzie szeregiem czasowym, a

będzie szeregiem czasowym, a ![]() ciągiem o wyrazach rzeczywistych. Wówczas szereg czasowy

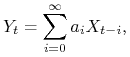

ciągiem o wyrazach rzeczywistych. Wówczas szereg czasowy ![]() , którego wyrazy dają się przedstawić jako sumy nieskończone w

, którego wyrazy dają się przedstawić jako sumy nieskończone w ![]()

|

nazywamy splotem ciągu ![]() i szeregu

i szeregu ![]() .

.

Operację splotu będziemy oznaczać przez ”![]() ”

”

Uwaga 14.4

W niektórych źródłach operację splotu z ciągiem ![]() nazywa się filtrem o współczynnikach

nazywa się filtrem o współczynnikach ![]() .

.

Podamy teraz dwa warunki gwarantujące istnienie splotu ![]() ciągu

ciągu ![]() i szeregu

i szeregu ![]() .

.

Twierdzenie 14.3

Jeżeli zachodzi jeden z poniższych warunków

| 1. | ||||

| 2. |

to istnieje splot ciągu ![]() i szeregu

i szeregu ![]() .

.

Dowód.

Skorzystamy z zasady majoryzacji.

Ad 1.

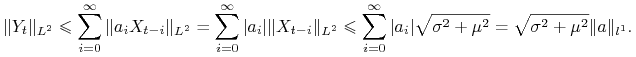

|

Ad 2.

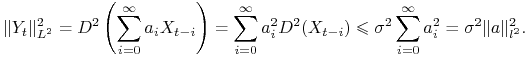

|

Twierdzenie 14.4

Gdy szereg czasowy ![]() jest stacjonarny rzędu 2, a ciąg

jest stacjonarny rzędu 2, a ciąg ![]() należy do

należy do ![]() to

ich splot

to

ich splot ![]() jest stacjonarny rzędu 2.

jest stacjonarny rzędu 2.

Dowód.

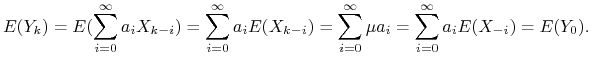

Pokażemy, że wartość oczekiwana i autokowariancje szeregu ![]() nie zmieniają się przy przesunięciu.

Oznaczmy przez

nie zmieniają się przy przesunięciu.

Oznaczmy przez ![]() wartość oczekiwaną

wartość oczekiwaną ![]() a przez

a przez ![]() funkcję autokowariancji.

funkcję autokowariancji.

|

|

|

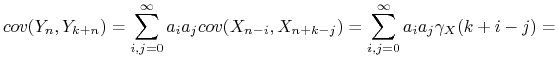

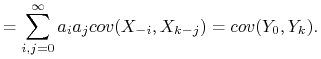

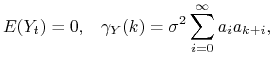

Twierdzenie 14.5

Gdy szereg czasowy ![]() jest białym szumem, a ciąg

jest białym szumem, a ciąg ![]() należy do

należy do ![]() to

ich splot

to

ich splot ![]() jest stacjonarny rzędu 2. Ponadto

jest stacjonarny rzędu 2. Ponadto

|

gdzie ![]() wariancja

wariancja ![]() .

.

Dowód.

Powtarzamy rozumowanie z poprzedniego dowodu i wstawiamy ![]() oraz

oraz ![]() i

i ![]() dla

dla ![]() .

.

Okazuje się, że z dokładnością do pewnego ”nieistotnego” składnika, wszystkie szeregi czasowe stacjonarne rzędu 2 można przedstawić w postaci splotu z białym szumem.

Twierdzenie 14.6

Niech ![]() będzie szeregiem czasowym stacjonarnym rzędu 2 o zerowej wartości oczekiwanej,

będzie szeregiem czasowym stacjonarnym rzędu 2 o zerowej wartości oczekiwanej, ![]() .

Wówczas istnieją ciąg

.

Wówczas istnieją ciąg ![]() klasy

klasy ![]() i unormowany biały szum

i unormowany biały szum ![]() takie, że

takie, że

gdzie szereg czasowy ![]() jest nieskorelowany z

jest nieskorelowany z ![]()

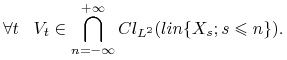

i ponadto jest zawarty w przecięciu domknięć (w ![]() ) podprzestrzeni generowanych przez początkowe

) podprzestrzeni generowanych przez początkowe ![]()

|

Dowód.

Powyższe twierdzenie jest wnioskiem z ”rozkładu Wolda” - [3] Theorem 5.7.1.

Operacja splotu przeprowadza szeregi czasowe stacjonarne rzędu 2 na szeregi czasowe stacjonarne rzędu 2. Zatem sploty można iterować.

Twierdzenie 14.7

Niech ciągi ![]() i

i ![]() należą do przestrzeni

należą do przestrzeni ![]() , a

, a ![]() będzie szeregiem czasowym stacjonarnym rzędu 2. Wówczas

będzie szeregiem czasowym stacjonarnym rzędu 2. Wówczas

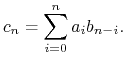

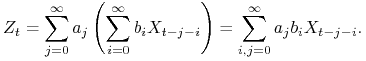

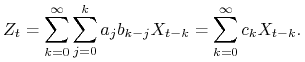

gdzie ![]() jest ciągiem o wyrazach

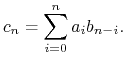

jest ciągiem o wyrazach

|

Uwaga 14.5

Ciąg ![]() z powyższego twierdzenia nazywa się iloczynem Cauchy'ego ciągów

z powyższego twierdzenia nazywa się iloczynem Cauchy'ego ciągów ![]() i

i ![]() . Jak łatwo sprawdzić

. Jak łatwo sprawdzić ![]() też należy do

też należy do ![]() . Zatem splot definiuje działanie algebry

. Zatem splot definiuje działanie algebry ![]() na zbiorze szeregów czasowych, które są stacjonarne rzędu 2.

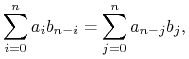

Ponadto mnożenie Cauchy'ego jest przemienne gdyż

na zbiorze szeregów czasowych, które są stacjonarne rzędu 2.

Ponadto mnożenie Cauchy'ego jest przemienne gdyż

|

zatem

dla ![]()

Dowód twierdzenia.

Oznaczmy przez ![]() splot

splot ![]() i

i ![]() , a przez

, a przez ![]() splot

splot ![]() i

i ![]() . Wówczas

. Wówczas

|

Przedstawiamy szereg ![]() w zależności od szeregu

w zależności od szeregu ![]()

|

Podstawiamy ![]() i porządkujemy powyższą sumę względem

i porządkujemy powyższą sumę względem ![]() .

.

|

Gdy szereg ![]() z twierdzenia 14.7 jest białym szumem to możemy osłabić założenia dotyczące ciągu

z twierdzenia 14.7 jest białym szumem to możemy osłabić założenia dotyczące ciągu ![]() .

W analogiczny sposób jak twierdzenie 14.7 dowodzi się następujące twierdzenie.

.

W analogiczny sposób jak twierdzenie 14.7 dowodzi się następujące twierdzenie.

Twierdzenie 14.8

Niech ciąg ![]() należy do przestrzeni

należy do przestrzeni ![]() , ciąg

, ciąg ![]() do

do ![]() , a

, a ![]() będzie białym szumem. Wówczas

będzie białym szumem. Wówczas

gdzie ![]() jest ciągiem o wyrazach

jest ciągiem o wyrazach

|

14.3. Funkcje tworzące

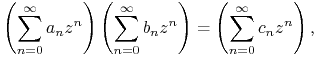

Mnożenie Cauchy'ego ciągów jest ściśle związane z mnożeniem szeregów potęgowych. Otóż

|

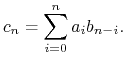

gdzie ciąg ![]() jest iloczynem Cauchy'ego ciągów

jest iloczynem Cauchy'ego ciągów ![]() i

i ![]()

|

Dlatego przyporządkujemy ciągom funkcje tworzące czyli sumy szeregów potęgowych. Pozwala to wykorzystać aparat analizy zespolonej do badania szeregów czasowych.

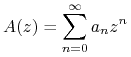

Definicja 14.7

Funkcję holomorficzną

|

nazywamy funkcją tworzącą ciągu liczbowego ![]() .

.

Zauważmy, że istnieje zależność między promieniem zbieżności ![]() szeregu potęgowego

szeregu potęgowego ![]() a klasą ciągu

a klasą ciągu ![]() .

.

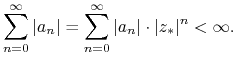

Lemat 14.2

Dowód.

Gdy promień zbieżności szeregu potęgowego ![]() jest większy od 1 to jest on zbieżny bezwzględnie w punkcie

jest większy od 1 to jest on zbieżny bezwzględnie w punkcie ![]() . Zatem

. Zatem

|

Natomiast gdy ciąg ![]() jest klasy

jest klasy ![]() to musi on zbiegać do 0

to musi on zbiegać do 0

Zatem

Z czego wynika, że promień zbieżności szeregu potęgowego ![]() jest nie mniejszy niż 1

jest nie mniejszy niż 1

![R_{A}=\left(\limsup _{{n\rightarrow\infty}}\sqrt[n]{a_{n}}\right)^{{-1}}\geq 1.](wyklady/ekn/mi/mi1259.png) |

Więc jeśli promień zbieżności ![]() jest mniejszy od 1, to ciąg

jest mniejszy od 1, to ciąg ![]() nie należy do

nie należy do ![]() .

.

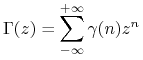

Funkcje tworzące dla funkcji autokowariancji określamy jako sumy szeregów Laurenta (por. [15] Cz. I, §6).

Definicja 14.8

Funkcję holomorficzną

|

określoną na pierścieniu

nazywamy funkcją tworzącą ciągu liczbowego ![]() .

.

Uwaga 14.6

Współczynniki rozwinięcia funkcji ![]() w szereg Laurenta na pierścieniu

w szereg Laurenta na pierścieniu

są wyznaczone jednoznacznie (por. [15] Cz. I, §6, Twierdzenie 2).

Lemat 14.3

Niech ![]() będzie funkcją autokowariancji szeregu czasowego

będzie funkcją autokowariancji szeregu czasowego ![]() stacjonarnego rzędu 2. Wówczas następujące warunki są równoważne:

stacjonarnego rzędu 2. Wówczas następujące warunki są równoważne:

1. Szereg Laurenta ![]() jest zbiezny w pewnym pierścieniu

jest zbiezny w pewnym pierścieniu

2. Szereg czasowy ![]() jest procesem o krótkiej pamięci.

jest procesem o krótkiej pamięci.

Dowód.![]() .

.

Z nierówności Cauchy'ego dla współczynników szeregu Laurenta ([15] s.120) otrzymujemy, że dla każdego ![]()

gdzie ![]() to maksimum modułu funkcji

to maksimum modułu funkcji ![]() na okręgu

na okręgu ![]() .

.

![]() .

.

Gdy szereg czasowy ![]() jest procesem o krótkiej pamięci to

istnieją stałe

jest procesem o krótkiej pamięci to

istnieją stałe ![]() i

i ![]() ,

, ![]() ,

, ![]() , takie, że

, takie, że

Zatem

Zatem szereg Laurenta ![]() jest zbieżny na pierścieniu

jest zbieżny na pierścieniu

(por. [15] s.117).

14.4. Operator przesunięcia

Oznaczymy przez ![]() operator przesunięcia szeregu czasowego o 1 w prawo

operator przesunięcia szeregu czasowego o 1 w prawo

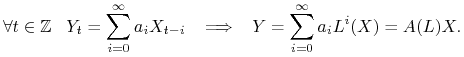

Pozwoli to nam zapisać splot ![]() jako szereg potęgowy iterowanych operatorów przesunięcia

jako szereg potęgowy iterowanych operatorów przesunięcia

|

Wniosek 14.1

Funkcja tworząca złożenia operatorów ![]() i

i ![]() jest iloczynem funkcji

jest iloczynem funkcji ![]() i

i ![]()

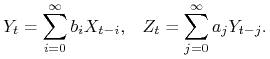

Funkcja tworząca funkcji autokowariancji szeregu czasowego ![]() będącego obrazem unormowanego białego szumu

będącego obrazem unormowanego białego szumu ![]() ,

,

![]() wynosi

wynosi

Uwaga 14.7

Gdy promień zbieżności szeregu potęgowego ![]() jest większy od 1 to szereg

jest większy od 1 to szereg ![]() jest zbieżny na pierścieniu

jest zbieżny na pierścieniu

Z powyższej uwagi i lematu 14.3 otrzymujemy:

Wniosek 14.2

Gdy promień zbieżności szeregu potęgowego ![]() jest większy od 1 to szereg czasowy

jest większy od 1 to szereg czasowy ![]() ,

, ![]() , jest procesem o krótkiej pamięci.

, jest procesem o krótkiej pamięci.

14.5. Przykłady

Przedstawimy teraz kilka najpopularniejszych szeregów czasowych stacjonarnych rzędu 2.

Niech ![]() będzie unormowanym białym szumem.

będzie unormowanym białym szumem.

1. Wielomianowa funkcja tworząca.

Szereg czasowy ![]() postaci

postaci

gdzie ![]() wielomian stopnia

wielomian stopnia ![]() nazywa się szeregiem średnich ruchomych rzędu

nazywa się szeregiem średnich ruchomych rzędu ![]() –

– ![]() .

.

2. Funkcja tworząca jest odwrotnością funkcji wielomianowej.

Szereg czasowy ![]() postaci

postaci

gdzie ![]() wielomian stopnia

wielomian stopnia ![]() , który nie zeruje się na kole jednostkowym

, który nie zeruje się na kole jednostkowym

nazywa się szeregiem autoregresyjnym rzędu ![]() –

– ![]() .

.

Szereg ![]() spełnia równanie

spełnia równanie

zatem

3. Funkcja tworząca jest ilorazem funkcji wielomianowych.

Szereg czasowy ![]() postaci

postaci

gdzie ![]() wielomian stopnia

wielomian stopnia ![]() a

a

![]() wielomian stopnia

wielomian stopnia ![]() , który nie zeruje się na kole jednostkowym

, który nie zeruje się na kole jednostkowym

nazywa się autoregresyjnym szeregiem średnich ruchomych rzędu ![]() –

– ![]() .

.

Szereg ![]() spełnia równanie

spełnia równanie

zatem

Biorąc pod uwagę, że funkcje tworzące w trzech powyższych przykładach mają promień zbieżności większy od 1, to na mocy wniosku 14.2 otrzymujemy:

Lemat 14.4

Szeregi czasowe ![]() ,

, ![]() i

i ![]() są procesami o krótkiej pamięci.

są procesami o krótkiej pamięci.

Uwaga 14.8

Niech ![]() będzie funkcją autokowariancji szeregu czasowego

będzie funkcją autokowariancji szeregu czasowego ![]() ,

, ![]() .

Gdy

.

Gdy ![]() jest klasy

jest klasy

![]() to operator

to operator ![]() jest wyznaczony przez funkcje autokowariancji

jest wyznaczony przez funkcje autokowariancji ![]() z dokładnością do znaku. Natomiast

dla szeregów czasowych

z dokładnością do znaku. Natomiast

dla szeregów czasowych ![]() i

i ![]() taka jednoznaczność

zachodzi tylko przy dodatkowym warunku, że funkcje tworzące nie zerują się w kole jednostkowym.

taka jednoznaczność

zachodzi tylko przy dodatkowym warunku, że funkcje tworzące nie zerują się w kole jednostkowym.

Przykład ![]() .

.

Rozważmy szereg czasowy

Funkcja ![]() jest holomorficzna na całej płaszczyźnie zespolonej poza punktem

jest holomorficzna na całej płaszczyźnie zespolonej poza punktem ![]() gdzie ma biegun.

Zatem promień zbieżności jej szeregu Taylora w 0 wynosi 3.

gdzie ma biegun.

Zatem promień zbieżności jej szeregu Taylora w 0 wynosi 3.

Okazuje się, że funkcja tworząca funkcji autokowariancji jest stała

Czyli szereg ![]() jest białym szumem. Zatem reprezentacja

jest białym szumem. Zatem reprezentacja ![]() szeregu czasowego o zadanej funkcji autokowariancji nie jest jednoznaczna.

szeregu czasowego o zadanej funkcji autokowariancji nie jest jednoznaczna.

14.6. Procesy o przyrostach stacjonarnych

Niech ![]() będzie dowolnym szeregiem czasowym.

Szereg

będzie dowolnym szeregiem czasowym.

Szereg ![]() taki, że

taki, że

czyli

nazywamy szeregiem przyrostów szeregu ![]() .

.

Operację brania przyrostów można iterować. Szereg

nazywamy szeregiem ![]() -tych przyrostów szeregu

-tych przyrostów szeregu ![]() .

.

Gdy ![]() -te przyrosty szeregu czasowego

-te przyrosty szeregu czasowego ![]() są stacjonarne rzędu 2 i należą do klasy

są stacjonarne rzędu 2 i należą do klasy ![]() to mówimy, że szereg

to mówimy, że szereg ![]() jest klasy

jest klasy ![]() .

.

Przykłady![]() Błądzenie przypadkowe bez dryfu

Błądzenie przypadkowe bez dryfu

jest procesem klasy ![]() .

.

![]() Błądzenie przypadkowe z dryfem

Błądzenie przypadkowe z dryfem

jest procesem klasy ![]() .

.

![]() Trend liniowy

Trend liniowy

jest procesem klasy ![]() .

.

![]() Trend wielomianowy stopnia

Trend wielomianowy stopnia ![]()

jest procesem klasy ![]() .

.

14.7. Ułamkowy ruch Browna

Definicja 14.9

Gaussowski proces ![]() ,

, ![]() ,

, ![]() ,

taki, że

,

taki, że

nazywamy ułamkowym ruchem Browna.

Pokażemy, że szereg ![]() jest procesem o przyrostach stacjonarnych.

Niech

jest procesem o przyrostach stacjonarnych.

Niech

Lemat 14.5

Szereg czasowy ![]() jest stacjonarny o zerowej wartości oczekiwanej,

jest stacjonarny o zerowej wartości oczekiwanej, ![]() , oraz funkcji autokowariancji

, oraz funkcji autokowariancji

Dowód.

Ponieważ ![]() jest szeregiem o zerowej wartości oczekiwanej to to samo zachodzi dla szeregu przyrostów. Natomiast

jest szeregiem o zerowej wartości oczekiwanej to to samo zachodzi dla szeregu przyrostów. Natomiast

Zatem ![]() jest stacjonarny z funkcją autokowariancji

jest stacjonarny z funkcją autokowariancji

Uwaga 14.9

Dla wszystkich ![]()

![]() . Dodatkowo dla

. Dodatkowo dla ![]() i

i ![]()

![]() .

Zatem

.

Zatem ![]() jest gaussowskim białym szumem, a

jest gaussowskim białym szumem, a ![]() jest gaussowskim błądzeniem przypadkowym.

jest gaussowskim błądzeniem przypadkowym.

Lemat 14.6

Dla ![]()

Dowód.

Dla ![]()

Uwaga 14.10

Gdy ![]() , to szereg czasowy

, to szereg czasowy ![]() jest procesem stacjonarnym o długiej pamięci.

jest procesem stacjonarnym o długiej pamięci.