Zagadnienia

5. Test  i analiza odpowiedniości

i analiza odpowiedniości

Rozdział ten będzie dotyczył zmiennych jakościowych. Omawiane niżej testy ![]() i niezależności opierają się na odległości

i niezależności opierają się na odległości ![]() dla rozkładów dyskretnych (1.1). W obu przypadkach będziemy rozpatrywać odległości rozkładów zaobserwowanego od teoretycznego, dla których statystyka będzie asymptotycznie zbiegać do znanego rozkładu

dla rozkładów dyskretnych (1.1). W obu przypadkach będziemy rozpatrywać odległości rozkładów zaobserwowanego od teoretycznego, dla których statystyka będzie asymptotycznie zbiegać do znanego rozkładu ![]() . Najpierw przyjrzyjmy się przypadkowi jednowymiarowemu.

. Najpierw przyjrzyjmy się przypadkowi jednowymiarowemu.

5.1. Test  Pearsona

Pearsona

Dana jest zmienna losowa jakościowa o rozkładzie wielomianowym o wartościach ![]() oraz prawdopodobieństwach

oraz prawdopodobieństwach ![]() . Podczas doświadczenia obserwujemy liczności, jakie przyjmowała zmienna w

. Podczas doświadczenia obserwujemy liczności, jakie przyjmowała zmienna w ![]() niezależnych próbach:

niezależnych próbach: ![]() . Teoretyczne liczności będą wartościami oczekiwanymi dla rozkładu wielomianowego:

. Teoretyczne liczności będą wartościami oczekiwanymi dla rozkładu wielomianowego: ![]() . Satystyka wyraża się wzorem:

. Satystyka wyraża się wzorem:

![Q=\sum _{{i=1}}^{k}\frac{(\widehat{n}_{i}-n_{i})^{2}}{n_{i}}\xrightarrow[n\rightarrow\infty]{d}\chi^{2}(k-1);](wyklady/st2/mi/mi433.png) |

przy spełnionej hipotezie zerowej ![]() zmienna losowa pochodzi z rozkładu wielomianowego o parametrach

zmienna losowa pochodzi z rozkładu wielomianowego o parametrach ![]() , zbiega ona według rozkładu do rozkładu

, zbiega ona według rozkładu do rozkładu ![]() o

o ![]() stopniach swobody.

stopniach swobody.

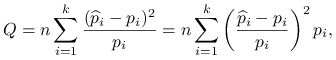

Omawianą statystykę można zapisać także jako:

|

gdzie ![]() to zaobserwowane prawdopodobieństwa (będące stymatorami największej wiarygodności parametrów

to zaobserwowane prawdopodobieństwa (będące stymatorami największej wiarygodności parametrów ![]() dla rozkładu wielomianowego).

dla rozkładu wielomianowego).

5.2. Test niezależności

Będziemy rozpatrywać dwie zmienne losowe o rozkładzie dyskretnym:

których rozkład łączny jest rozkładem wielomianowym o nieznanych parametrach ![]() ,

, ![]() ,

, ![]() . Znane są jedynie zaobserwowane liczności dla każdej pary

. Znane są jedynie zaobserwowane liczności dla każdej pary ![]() w postaci macierzy kontyngencji.

w postaci macierzy kontyngencji.

Definicja 5.1

Macierz kontyngencji to macierz ![]() o wymiarach

o wymiarach ![]() zawierająca zaobserwowane liczności

zawierająca zaobserwowane liczności ![]() ,

, ![]() , dla każdej z par wartości zmiennych losowych

, dla każdej z par wartości zmiennych losowych ![]() :

:

![\begin{array}[]{c|ccc}X\setminus Y&1&\ldots&l\\

\hline 1&n_{{11}}&\ldots&n_{{1l}}\\

\ldots&\ldots&\ldots&\ldots\\

k&n_{{k1}}&\ldots&n_{{kl}}\end{array}](wyklady/st2/mi/mi456.png) |

Hipotezę, którą będziemy testować to:

W tym celu policzymy odległość rozkładu zaobserwowanego od teoretycznego rozumianego jako iloczyn rozkładów brzegowych. Macierz zaobserwowanych prawdopodobieństw możemy zapisać jako:

gdzie ![]() to macierz kontyngencji, a

to macierz kontyngencji, a ![]() to suma wszystkich elementów tej macierzy.

Statystyka testowa wyraża się wzorem:

to suma wszystkich elementów tej macierzy.

Statystyka testowa wyraża się wzorem:

![n\sum _{{i=1}}^{k}\sum _{{j=1}}^{l}\frac{(\widehat{p}_{{ij}}-\widehat{p}_{{i.}}\widehat{p}_{{.j}})^{2}}{\widehat{p}_{{i.}}\widehat{p}_{{.j}}}\xrightarrow[n\rightarrow\infty]{d}\chi^{2}\left((k-1)(l-1)\right),](wyklady/st2/mi/mi443.png) |

gdzie ![]() i

i ![]() to zaobserwowane rozkłady brzegowe dla

to zaobserwowane rozkłady brzegowe dla ![]() i

i ![]() .

.

5.3. Analiza odpowedniości (correspondence analysis)

Tak jak w poprzednim podrozdziale, dane mamy dwie zmienne losowe ![]() i

i ![]() o rozkładzie dyskretnym. Analiza odpowiedniości to metoda prezentacji danych w przestrzeni o niewielkim wymiarze (zwykle równym 2, wtedy prezentację można przedstawić na płaszczyźnie), ilustrująca zależności pomiędzy danymi cechami

o rozkładzie dyskretnym. Analiza odpowiedniości to metoda prezentacji danych w przestrzeni o niewielkim wymiarze (zwykle równym 2, wtedy prezentację można przedstawić na płaszczyźnie), ilustrująca zależności pomiędzy danymi cechami ![]() i

i ![]() .

.

Przykład 5.1

Rozpatrzmy następujący przykład: dla każdej osoby obserwujemy kolor oczu i włosów. Zmienna losowa ![]() będzie oznaczać jeden z czterech kolorów oczu: brown, blue, hazel, green. Zmienna losowa

będzie oznaczać jeden z czterech kolorów oczu: brown, blue, hazel, green. Zmienna losowa ![]() będzie oznaczać jeden z czterech kolorów włosów: black, brown, red, blond. Tablica kontyngencji dla tego przykładu:

będzie oznaczać jeden z czterech kolorów włosów: black, brown, red, blond. Tablica kontyngencji dla tego przykładu:

![\begin{array}[]{c|cccc}\text{eyes}\setminus\text{hair}&\text{black}&\text{brown}&\text{red}&\text{blond}\\

\hline\text{brown}&68&119&26&7\\

\text{blue}&20&84&17&94\\

\text{hazel}&15&54&14&10\\

\text{green}&5&29&14&16\end{array}](wyklady/st2/mi/mi440.png) |

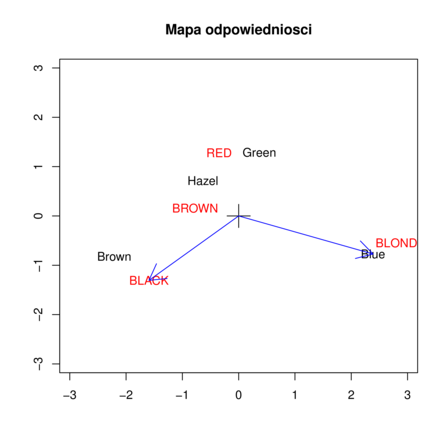

Analiza odpowiedniości pozwoli nam na przedstawienie graficzne zależności pomiędzy kolorami włosów i oczu. Na przykład, będziemy mogli zobaczyć, czy osoby o niebieskim kolorze oczu mają najczęsciej włosy koloru blond.

Do analizy korespondencji potrzebna nam będzie macierz rezyduów Pearsona, której konstrukcję omówimy przy pomocy komend programu ![]() :

:

N=table(cbind(X,Y)) # macierz kontyngencji, gdzie X i Y to faktory P=N/sum(N) # macierz zaobserwowanych prawdopodobieństw Pi=apply(P,1,sum) # rozkład brzegowy dla X Pj=apply(P,2,sum) # rozkład brzegowy dla Y PP=Pi%*%t(Pj) RP=sqrt(sum(N))*(P-PP)/sqrt(PP) # macierz rezyduów Pearsona

Uwaga 5.1

Zauważmy, że sum(RP^2) to statystyka testowa dla testu niezależności.

Przykład 5.1

Sama postać macierzy ![]() może nam wiele powiedzieć o zależności poszczególnych cech. Macierz rezyduów Pearsona dla przykładu kolory oczu i włosów znajduje się w tabeli 5.1.

może nam wiele powiedzieć o zależności poszczególnych cech. Macierz rezyduów Pearsona dla przykładu kolory oczu i włosów znajduje się w tabeli 5.1.

| BLACK | BROWN | RED | BLOND | |

|---|---|---|---|---|

| Brown | 4.40 | 1.23 | -0.07 | -5.85 |

| Blue | -3.07 | -1.95 | -1.73 | 7.05 |

| Hazel | -0.48 | 1.35 | 0.85 | -2.23 |

| Green | -1.95 | -0.35 | 2.28 | 0.61 |

Największe dodatnie wartości, a więc największą dodatnią zależność pomiędzy cechami mamy dla par (brown,black) i (blue,blond). Największą ujemne wartości, a więc największą ujemną zależność obserwujemy dla par (blue,black) i (brown,blond).

Celem analizy odpowiedniości jest przedstawienie cech ![]() i

i ![]() na płaszczyźnie, żeby widoczne były zależności między nimi. W tym celu zmniejszymy wymiar

na płaszczyźnie, żeby widoczne były zależności między nimi. W tym celu zmniejszymy wymiar ![]() do 2, używając do tego analizy składowych głównych. Wiemy, że takie przybliżenie jest najlepsze w sensie błędu średniokwadratowego i opisuje możliwie najwięcej zmienności danych.

do 2, używając do tego analizy składowych głównych. Wiemy, że takie przybliżenie jest najlepsze w sensie błędu średniokwadratowego i opisuje możliwie najwięcej zmienności danych.

Cechy ![]() i

i ![]() przedstawiamy jako punkty:

przedstawiamy jako punkty:

Pamiętamy z rozkładu SVD, że ![]() ,

, ![]() ,

, ![]() rozpina przestrzeń kolumn macierzy

rozpina przestrzeń kolumn macierzy ![]() , a

, a ![]() przestrzeń wierszy. Scentrowane punkty (od kolumn macierzy

przestrzeń wierszy. Scentrowane punkty (od kolumn macierzy ![]() i

i ![]() odejmujemy średnie w kolumnach tak żeby środek danych był w (0,0)) nanosimy na wykres (rysunek 5.1).

odejmujemy średnie w kolumnach tak żeby środek danych był w (0,0)) nanosimy na wykres (rysunek 5.1).

Przykład 5.1

Dla interpretacji mapy odpowiedniości, potraktujmy wiersze macierzy ![]() oraz

oraz ![]() jako współrzędne wektorów, zaczepionych w punkcie (0,0). Wiersze macierzy

jako współrzędne wektorów, zaczepionych w punkcie (0,0). Wiersze macierzy ![]() odpowiadają kolorom oczu, wiersze macierzy

odpowiadają kolorom oczu, wiersze macierzy ![]() kolorom włosów. Na rysunku zaznaczone zostały dla przykładu wektory odpowiadające cechom blue oraz black. Zauważmy, że iloczyn skalarny dwóch wektorów, i-tego z macierzy

kolorom włosów. Na rysunku zaznaczone zostały dla przykładu wektory odpowiadające cechom blue oraz black. Zauważmy, że iloczyn skalarny dwóch wektorów, i-tego z macierzy ![]() i j-tego z macierzy

i j-tego z macierzy ![]() równy jest przybliżeniu macierzy rezyduów Pearsona. Oznaczmy:

równy jest przybliżeniu macierzy rezyduów Pearsona. Oznaczmy:

gdzie ![]() oznacza kąt pomiędzy wektorami. Interpretacja dla wektorów blue i black może być następująca: ponieważ długości obu wektorów są duże oraz

oznacza kąt pomiędzy wektorami. Interpretacja dla wektorów blue i black może być następująca: ponieważ długości obu wektorów są duże oraz ![]() jest ujemne o wartości bezwzględnej w przybliżeniu

jest ujemne o wartości bezwzględnej w przybliżeniu ![]() , zależność pomiędzy cechami jest silnie ujemna. Na tej samej zasadzie możemy zaobserwować silną zależność pomiędzy włosami blond i oczami blue oraz włosami black i oczami brown.

, zależność pomiędzy cechami jest silnie ujemna. Na tej samej zasadzie możemy zaobserwować silną zależność pomiędzy włosami blond i oczami blue oraz włosami black i oczami brown.

5.4. Przykłady w programie R

Analiza odpowiedniości oraz konstrukcja testu ![]() dla danych kolor oczu i włosów:

dla danych kolor oczu i włosów: